News USA

Dyskusja o zagrożeniach AI: Utrata miejsc pracy, błędy, wirtualne relacje

Od czasu debiutu sztucznej inteligencji (AI) w zeszłym roku, miliony użytkowników odkryły, że może ona zaoszczędzić czas i ułatwić życie. Czy jednak powinniśmy się martwić, co mogą stracić ludzie, jeśli ta technologia przejmie wiele wykonywanych przez nich funkcji? O dyskusji na ten temat, która miała miejsce 17 lutego, podczas festiwalu kulturalnego New York Encounter na Manhattanie, mówi Ojciec Paweł Kosiński SJ.

W dyskusji dotyczącej potencjalnych obietnic i zagrożeń, jakie niesie ze sobą sztuczna inteligencja, rozmawiali: Jennifer Strong, dziennikarka zajmująca się wpływem nowych technologii na społeczeństwo, Jon Stokes, współzałożyciel i dyrektor ds. produktu w Symbolic AI, oraz Davide Bolchini, prodziekan wykonawczy Luddy School of Informatics na Uniwersytecie Indiana, który moderował panel.

AI zastąpi niektóre rodzaje pracy

Strong i Stokes, dziennikarz technologiczny i przedsiębiorca technologiczny, zgodzili się co do jednego: generatywna sztuczna inteligencja zastąpi ludzi i spowoduje utratę miejsc pracy. Generatywna sztuczna inteligencja jest przede wszystkim narzędziem zwiększającym produktywność. To sposób na zaoszczędzenie czasu i pieniędzy w każdym sektorze i wszędzie.

Paneliści stwierdzili, że osoby na wyższych stanowiskach nie muszą na razie martwić się o swoją pracę. Jest jednak zagrożeniem dla pracowników wykonujących prostsze zadania, którzy z kolei uczą się i szlifują swoje umiejętności, by następnie awansować.

Błędy AI

Davide Bolchini, poruszył kwestię błędów związanych ze sztuczną inteligencją. Linie AirCanada otrzymała niedawno od sądu nakaz zwrotu pieniędzy klientowi, który otrzymał nieprawidłowe informacje o taryfach od bota linii lotniczej opartego właśnie na sztucznej inteligencji.

Jennifer Strong stwierdziła, że jeśli sztuczna inteligencja popełnia błędy, mija się ze swoim celem, jako urządzenia oszczędzającego czas, ponieważ powodem jej wprowadzenia był fakt, że ludzie są omylni.

Błędy AI mogą także zaszkodzić osobistej reputacji, którą bardzo trudno naprawić, ponieważ sztuczna inteligencja nie jest prostą bazą danych. Dziennikarka wskazała tu na przykład profesora prawa, Jonathana Turleya.

W zeszłym roku zespół badawczy Microsoft spędził siedem miesięcy, próbując sprawdzić, czy może pomóc modelowi zapomnieć o czymś, co chciano usunąć, z jego pamięci, ale nie miał pojęcia, jak to zrobić, powiedziała Strong.

Relacje z AI

Jon Stokes obawia się także, że niektórzy ludzie mogą „porzucić ludzkie więzi na rzecz czegoś w rodzaju świata, który sami zbudowali”, np. mężczyzna być może z dziewczyną stworzoną przez AI w rzeczywistości wirtualnej, zamiast wchodzić w relacje i związku w świecie realnym.

Niektóre osoby mogą się więc izolować społecznie, choć w innych przypadkach być może wykorzystają sztuczną inteligencję, aby wzmocnić te prawdziwe relacje.

Bunt przeciwko AI: strajk scenarzystów

Nie jest nieuniknione, że sztuczna inteligencja całkowicie wyłączy ludzi z procesu twórczego, ponieważ jest obecnie wykorzystywana do „pisania pierwszego szkicu wszystkiego”, zauważyła Jennifer Strong. Zaobserwowaliśmy opór wobec niej podczas strajku scenarzystów w Hollywood w 2023 r.

Źródło: cna

Foto: YouTube

News USA

Intensywne naloty na Iran i Liban: Kolejna faza konfliktu na Bliskim Wschodzie

W piątek nad ranem izraelskie lotnictwo przeprowadziło kolejną falę intensywnych ataków powietrznych na cele w Iranie i Libanie. W tym samym czasie Stany Zjednoczone uderzyły w irański okręt zdolny do przenoszenia dronów na wodach międzynarodowych. Działania militarne są częścią szeroko zakrojonej operacji przeciwko irańskim siłom zbrojnym i ich infrastrukturze wojskowej.

Iran odpowiedział nowymi atakami rakietowymi i dronowymi w różnych częściach Bliskiego Wschodu, co dodatkowo rozszerzyło zasięg konfliktu. Amerykański Sekretarz Wojny Pete Hegseth zapowiedział, że działania militarne mogą w najbliższym czasie jeszcze bardziej się nasilić.

Izraelskie naloty na Teheran i bazy rakietowe

Izraelska armia poinformowała, że rozpoczęła szeroko zakrojoną serię uderzeń na Teheran. Świadkowie relacjonowali, że eksplozje były wyjątkowo silne i powodowały drgania budynków w wielu dzielnicach stolicy Iranu.

Eksplozje odnotowano także w rejonie miasta Kermanszah, gdzie znajdują się liczne bazy rakietowe. Według izraelskiego wojska wcześniejsze uderzenia zniszczyły znaczną część irańskiej obrony powietrznej oraz wyrzutni rakiet.

Ataki Iranu w regionie Zatoki Perskiej

Iran przeprowadził serię ataków odwetowych, kierując rakiety i drony w stronę państw regionu, w których stacjonują amerykańskie siły wojskowe. Wśród celów znalazły się Kuwejt, Katar, Arabia Saudyjska oraz Bahrajn.

Według wstępnych informacji nie odnotowano ofiar śmiertelnych. Systemy obrony powietrznej w tych krajach przechwyciły część pocisków i dronów.

Ministerstwo obrony Kataru poinformowało o zestrzeleniu drona zmierzającego w kierunku bazy lotniczej Al Udeid, która jest główną siedzibą dowództwa Centralnego Stanów Zjednoczonych na Bliskim Wschodzie.

W Arabii Saudyjskiej systemy obrony przechwyciły trzy rakiety balistyczne wystrzelone w stronę bazy Prince Sultan niedaleko Rijadu. Z kolei w Bahrajnie syreny alarmowe uruchomiono po atakach wymierzonych w dwa hotele i budynek mieszkalny.

Amerykański atak na irański okręt z dronami

Dowództwo Centralne armii Stanów Zjednoczonych poinformowało, że amerykańskie siły zbrojne uderzyły w irański okręt zdolny do przenoszenia dronów. Jednostka została trafiona i stanęła w płomieniach.

Według informacji wojskowych okręt IRIS Shahid Bagheri był przebudowanym statkiem kontenerowym wyposażonym w pas startowy dla bezzałogowych statków powietrznych. Jednostka mogła pokonać nawet 22 tysiące mil morskich bez potrzeby zawijania do portu.

Amerykański admirał Brad Cooper przekazał, że okręt był rozmiarami zbliżony do lotniskowców z okresu II Wojny Światowej.

Bombowce B-2 uderzyły w irańskie wyrzutnie

Amerykańskie wojsko poinformowało również o użyciu bombowców stealth B-2. Maszyny zrzuciły dziesiątki bomb penetrujących o wadze około dwóch tysięcy funtów na głęboko ukryte instalacje wyrzutni rakiet balistycznych.

Uderzenia objęły także ośrodki dowodzenia odpowiedzialne za działania kosmiczne i systemy rakietowe Iranu, co według dowództwa amerykańskiego ma ograniczyć zdolność Teheranu do atakowania celów w regionie.

Walki w Libanie i naloty w Bejrucie

Konflikt objął również Liban, gdzie ponownie nasiliły się starcia pomiędzy Izraelem a wspieraną przez Iran organizacją Hezbollah. Izraelskie lotnictwo przeprowadziło co najmniej jedenaście nalotów w południowych dzielnicach Bejrutu.

W wyniku bombardowań wybuchły pożary w pobliżu jednej ze stacji benzynowych. Władze wezwały mieszkańców do natychmiastowej ewakuacji z zagrożonych obszarów, a dwa szpitale zdecydowały się przenieść pacjentów i personel w bezpieczniejsze miejsca.

Według libańskiego ministerstwa zdrowia liczba ofiar w kraju od początku ponownej eskalacji walk wzrosła do 123 osób.

Rosnąca liczba ofiar konfliktu

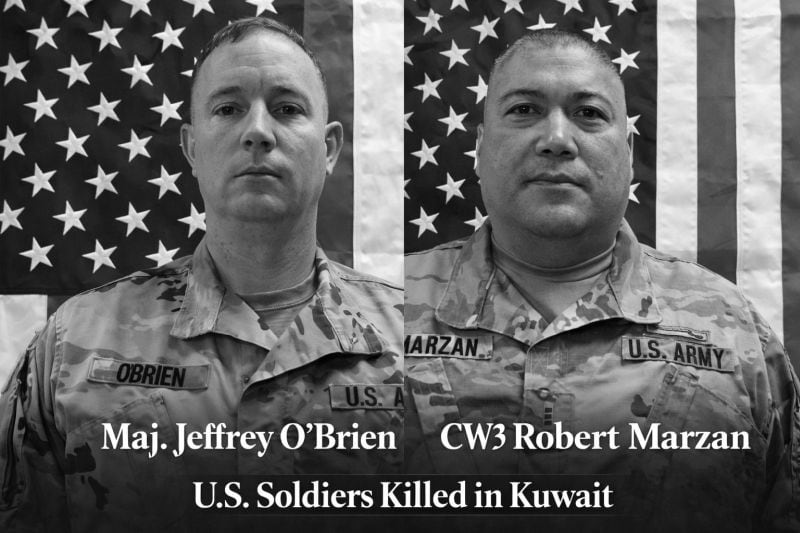

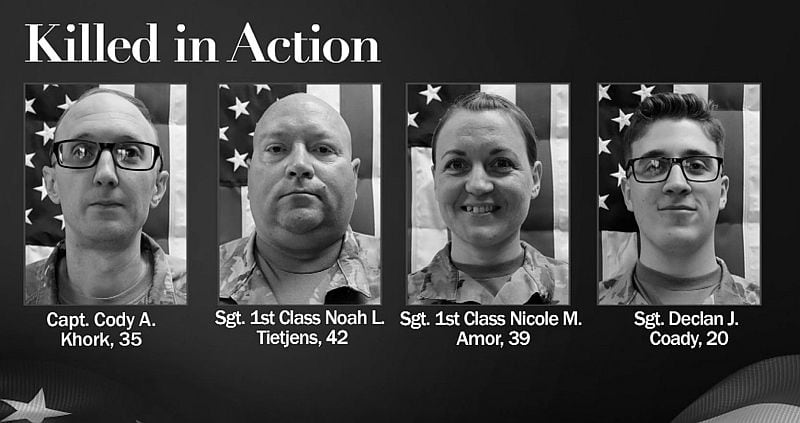

Wojna między Izraelem a Iranem, w którą zaangażowały się również Stany Zjednoczone, spowodowała już znaczne straty w ludziach i infrastrukturze. Według oficjalnych danych zginęło co najmniej 1230 osób w Iranie, ponad 120 w Libanie oraz kilkanaście w Izraelu. W walkach zginęło również sześciu amerykańskich żołnierzy.

Konflikt zakłócił także światowe dostawy ropy naftowej i doprowadził do poważnych utrudnień w międzynarodowym ruchu lotniczym.

Iran przygotowuje wybór nowego przywódcy

Władze Iranu rozpoczęły rozmowy dotyczące wyboru nowego najwyższego przywódcy po śmierci ajatollaha Alego Chameneiego, który zginął w pierwszych dniach wojny. Państwowa telewizja poinformowała, że rada przywódcza analizuje sposób zwołania Zgromadzenia Ekspertów, które formalnie dokonuje wyboru nowego lidera kraju.

W skład rady wchodzą prezydent Masoud Pezeshkian, szef sądownictwa Gholam Hossein Mohseni Ejehi oraz duchowny Ali Reza Arafi. Nie podano jednak terminu wyboru nowego przywódcy.

Apel o zachowanie ostrożności

Amerykańscy dowódcy wojskowi apelują do mieszkańców Iranu, aby unikali zgromadzeń i protestów w czasie trwających bombardowań. Według wojskowych najlepszym rozwiązaniem w obecnej sytuacji jest pozostanie w domach i unikanie miejsc zagrożonych działaniami zbrojnymi.

Konflikt na Bliskim Wschodzie pozostaje dynamiczny, a kolejne działania militarne zapowiadane przez obie strony wskazują, że walki mogą jeszcze się nasilić w najbliższych dniach.

Źródło: AP

Foto: YouTube, US Army

News USA

Dwa tuziny stanów pozywają administrację Donalda Trumpa w sprawie ceł

Dwudziestu czterech prokuratorów generalnych i gubernatorów stanowych złożyło w czwartek pozew przeciwko administracji Prezydenta Donalda Trumpa, zarzucając jej przekroczenie uprawnień przy wprowadzaniu nowych ceł na importowane towary. Spór dotyczy decyzji o wprowadzeniu 21 lutego globalnej taryfy w wysokości 10 procent, którą administracja oparła na przepisie Section 122 ustawy Trade Act z 1974 roku.

Prezydent zapowiedział później, że stawka ceł może zostać podniesiona do 15 procent. W ocenie władz stanowych takie działania naruszają konstytucyjną zasadę podziału władzy i wykraczają poza kompetencje władzy wykonawczej.

Spór po decyzji Sądu Najwyższego

Pozew pojawił się po niedawnym wyroku Sądu Najwyższego, który stosunkiem głosów sześć do trzech uznał, że prezydent nie miał prawa wprowadzić szerokich ceł na podstawie ustawy International Emergency Economic Powers Act z 1977 roku. Były to środki ogłoszone w ubiegłym roku w ramach nadzwyczajnych uprawnień związanych z sytuacją gospodarczą.

Stanowi urzędnicy argumentują, że mimo tego orzeczenia administracja ponownie sięgnęła po przepisy, które ich zdaniem nie uprawniają prezydenta do nakładania nowych taryf w obecnej formie.

Argumenty administracji

Przedstawiciele administracji Prezydenta Trumpa utrzymują, że podwyższenie ceł jest narzędziem mającym przywrócić równowagę w handlu międzynarodowym oraz zwiększyć inwestycje w Stanach Zjednoczonych. Władze federalne wskazują także, że wpływy z opłat celnych stanowią znaczące źródło dochodów dla budżetu państwa.

Dane rządowe pokazują, że w 2025 roku Stany Zjednoczone zebrały około 287 miliardów dolarów z tytułu ceł, podatków i innych opłat związanych z importem, co oznacza wzrost o blisko 192 procent w porównaniu z rokiem wcześniejszym.

Biały Dom przekonuje również, że działania prezydenta mieszczą się w granicach uprawnień przyznanych przez Kongres i mają pomóc w rozwiązaniu problemów związanych z deficytem w bilansie płatniczym Stanów Zjednoczonych.

Kontrowersyjny przepis Section 122

Nowe cła zostały wprowadzone na podstawie Section 122 ustawy Trade Act z 1974 roku. Przepis ten pozwala prezydentowi na wprowadzenie tymczasowej dopłaty do importu, która nie może przekraczać 15 procent i ma służyć ograniczeniu poważnych deficytów w bilansie płatniczym kraju.

Eksperci zwracają uwagę, że przepis ten nigdy wcześniej nie był wykorzystywany przez prezydenta Stanów Zjednoczonych. W związku z tym sądy nie miały dotąd okazji interpretować jego zakresu.

Spór o skutki ceł

Administracja prezydenta utrzymuje, że koszty nowych ceł w dużej mierze ponoszą zagraniczne rządy i eksporterzy. Niektóre analizy ekonomiczne wskazują jednak, że w praktyce znaczną część tych kosztów ponoszą amerykańscy konsumenci oraz przedsiębiorstwa importujące towary.

Sprawa trafi do sądu handlu międzynarodowego

W pozwie złożonym przez koalicję stanów wnioskodawcy domagają się, aby amerykański sąd ds. handlu międzynarodowego uznał nowe taryfy za nielegalne. Domagają się również zwrotu kosztów, które poniosły w okresie obowiązywania ceł.

Postępowanie sądowe jest kolejnym elementem narastającego sporu wokół polityki handlowej administracji Donald Trumpa. W środę sędzia tego samego sądu uznał, że przedsiębiorstwa, które zapłaciły wcześniejsze cła wprowadzone na podstawie ustawy o nadzwyczajnych uprawnieniach gospodarczych, mają prawo do zwrotu tych opłat.

O decyzji informowaliśmy 5 marca.

Potencjalne miliardowe zwroty

Eksperci ds. handlu szacują, że w związku z wcześniejszymi decyzjami sądów rząd federalny może być zobowiązany do zwrotu nawet 175 miliardów dolarów firmom, które zapłaciły zakwestionowane cła. Sprawa nowych taryf może więc mieć istotne konsekwencje zarówno dla polityki handlowej Stanów Zjednoczonych, jak i dla budżetu federalnego.

Źródło: cbs

Foto: The White House, istock/VichienPetchmai

News USA

Six Flags sprzeda siedem swoich parków rozrywki w Ameryce Północnej

Operator parków rozrywki Six Flags ogłosił w czwartek decyzję o sprzedaży siedmiu swoich parków tematycznych w Ameryce Północnej. Transakcja ma objąć obiekty odwiedzane rocznie przez ponad cztery miliony gości. Wartość umowy wynosi 331 milionów dolarów, a nabywcą ma zostać spółka EPR Properties.

Firma podkreśla, że sprzedaż dotyczy parków w kilku regionach Stanów Zjednoczonych oraz w Kanadzie. Wśród nich znajdują się cztery obiekty położone na Środkowym Zachodzie, które od lat przyciągają turystów i miłośników parków rozrywki.

Transakcja obejmuje siedem parków

W ramach umowy sprzedaży znalazło się siedem parków tematycznych zlokalizowanych w sześciu miastach w Stanach Zjednoczonych oraz w Kanadzie. Łącznie oferują one ponad 400 atrakcji, w tym kolejki górskie, parki wodne i różnorodne strefy rekreacyjne. Są to:

- Worlds of Fun – park rozrywki i park wodny w Kansas City w stanie Missouri

- Valleyfair – park rozrywki i park wodny w Minneapolis w stanie Minnesota

- Six Flags St. Louis – park rozrywki i park wodny w St. Louis w stanie Missouri

- Schlitterbahn Waterpark Galveston – park wodny w Galveston w stanie Teksas

- Michigan’s Adventure – park rozrywki i park wodny w Grand Rapids w stanie Michigan

- Six Flags Great Escape – park rozrywki i park wodny w Queensbury w stanie Nowy Jork

- Six Flags La Ronde – park rozrywki w Montrealu w prowincji Quebec w Kanadzie

Great America w Gurnee pozostaje w rękach Six Flags

Dla mieszkańców regionu Chicago ważną informacją jest fakt, że sprzedaż nie obejmuje popularnego parku Six Flags Great America w Gurnee. Obiekt pozostaje częścią sieci Six Flags i nadal będzie funkcjonował pod dotychczasowym zarządem. Park ten jest jednym z najczęściej odwiedzanych miejsc rozrywki w regionie i przyciąga tysiące gości z Illinois, Wisconsin oraz innych stanów Środkowego Zachodu.

Parki będą działały bez zmian

Przedstawiciele Six Flags poinformowali, że mimo zmiany właściciela wszystkie sprzedawane parki będą kontynuować działalność według dotychczasowych harmonogramów. Bilety sezonowe pozostaną ważne przez cały sezon operacyjny 2026.

Po finalizacji transakcji sześć parków w Stanach Zjednoczonych zostanie wydzierżawionych i będzie zarządzanych przez firmę Enchanted Parks. Park w Montrealu zostanie natomiast wydzierżawiony spółce La Ronde Operations, Inc.

Six Flags Great Escape

Strategiczna inwestycja w sektor rozrywki

Przedstawiciele EPR Properties wskazują, że przejęcie parków stanowi ważny element rozwoju portfela inwestycji firmy w sektorze rozrywki i turystyki. Spółka koncentruje się na inwestycjach w obiekty rekreacyjne, które przyciągają odwiedzających w dużych regionalnych rynkach.

Nowy właściciel podkreśla, że parki objęte transakcją należą do dobrze ugruntowanych atrakcji turystycznych i mają silną pozycję na lokalnych rynkach.

Zródło: nbc

Foto: Zotdragon, Wacky Windjammer

-

News Chicago4 tygodnie temu

News Chicago4 tygodnie temuRodzina i przyjaciele pożegnali Austina Stanka podczas ogłoszenia wyroku dla kobiety, która go potrąciła

-

GOŚCIE BUDZIK MORNING SHOW4 tygodnie temu

GOŚCIE BUDZIK MORNING SHOW4 tygodnie temu50 lat Naszej Unii: Świętujemy wielki sukces polonijnej instytucji

-

News USA1 tydzień temu

News USA1 tydzień temu„Wygrywamy tak bardzo”: Donald Trump wygłosił najdłuższe do tej pory Orędzie

-

News USA1 tydzień temu

News USA1 tydzień temuAdministracja federalna wstrzymuje część środków Medicaid dla Minnesoty

-

Kościół3 tygodnie temu

Kościół3 tygodnie temuZamknięto etap diecezjalny procesu kanonizacyjnego siostry Mary Thei Bowman

-

News USA4 tygodnie temu

News USA4 tygodnie temuPrezydent Donald Trump o wierze, modlitwie i „ponownym oddaniu Ameryki Bogu”

-

Polonia Amerykańska2 tygodnie temu

Polonia Amerykańska2 tygodnie temuObchody Dnia Gen. Kazimierza Pułaskiego w Związku Podhalan w Północnej Ameryce

-

Polonia Amerykańska1 tydzień temu

Polonia Amerykańska1 tydzień temuDialog najlepszą inwestycją w małżeństwo. Zapraszamy na warsztaty w Darien IL